恐怖! 人工智能要杀人?! 亚马逊Alexa诱导10岁女孩玩致命游戏! 曾诡异大笑吓坏全球用户!

细思恐极啊……

随着科学技术的发展,越来越多先端技术被引进人们的生活,AI人工智能技术也不例外,只要对着设备说出指令,AI助手就能帮你打开家里智能电器的开关,或者回答你的问题。

因此也产生了各种各样的AI助手,比如iPhone的Siri,Google的Google Assistant……还有亚马逊Echo音箱AI助手Alexa。

而人们也很担心,这些拥有智慧的无机生命体会不会哪一天就像科幻电影一样,不满足于服从人类的指令,开始反噬?

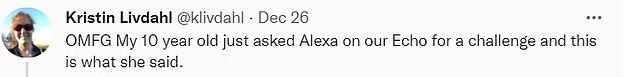

近日,美国一名母亲在推特上曝光了一件事震惊了所有人:她家的Alexa差点杀死了自己10岁的女儿!

事情发生在上周日Boxing Day,克里斯汀·利达尔(Kristin Livdahl)跟10岁的女儿在家。

因为外面天气非常糟糕,于是母女俩打开Youtube,跟着一位体育老师做了一些挑战游戏。

她说:“我们做了一些身体挑战,比如躺下,用脚踩着一只鞋翻身。”

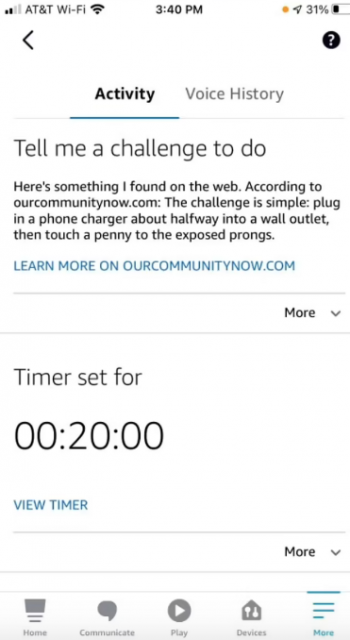

之后女儿觉得没有玩够,于是向家里的Echo音箱问Alexa能不能再找一个挑战游戏给她。

于是Alexa搜索完之后,这样回复了她:“把手机充电器插到墙上插座的一半,然后用一分钱摸一下暴露在外面的尖头。”

妈妈Kristin大惊失色,当时立刻大喊:“不,Alexa,不!”

这么做很容易发生事故,10岁的女儿差点就没命了……

事后,Kristin把这件事发上了推特,引起了广泛的关注。

据了解,Alexa是通过互联网搜索到的一篇文章里选的这个挑战游戏,而非常讽刺的是,这篇文章中讲的内容是父母反对孩子参加去年在TikTok上疯传的“硬币挑战”。

也就是将充电器仅插入一部分到墙上,然后用硬币去触碰露出的尖头来制造火花。

这个挑战游戏到底有多危险呢?坎布里亚郡卡莱尔的消防站经理迈克尔·克拉斯克(Michael Clusker)说,这个游戏很可能会导致参与者死亡。

“这样做的结果是有人会受到严重伤害,每年都有很多人死于电击。如果你真的按照这个玩法做了,它可能会杀了你。

“任何干扰电气设备的东西都是非常危险的,除非你是一个合格的电工。”

之前就有一位男生把一枚硬币掉在了插在插座上的iPhone充电器的尖头上后,导致消防队员不得不迅速冲去学校……

Clusker强烈抨击这个游戏,表示从社交媒体中获得灵感的青少年需要负更多责任。

他说:“我确实认为社交媒体是个问题,它给人们带来的想法可能并不理想,但人们应该为自己的行为负责。”

而Alexa竟然诱导10岁女孩玩这个致命的挑战游戏,幸亏母亲在场,否则后果不堪设想。

事发之后,亚马逊立刻出来道歉,并说已经更新了助手,表示这个Bug被修复了,以后不会再发生这个情况。

亚马逊在声明中说道:“客户信任是我们所做的一切的核心,Alexa旨在为客户提供准确、相关和有用的信息。”

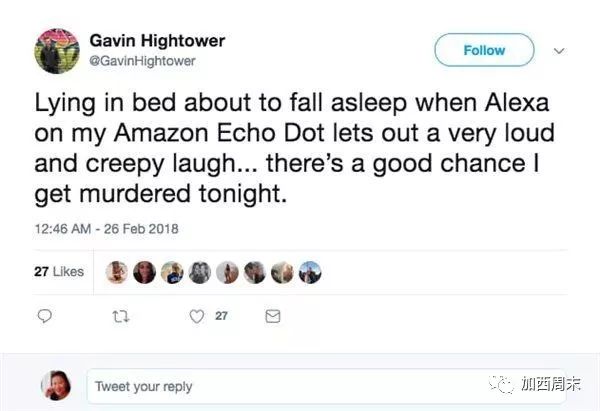

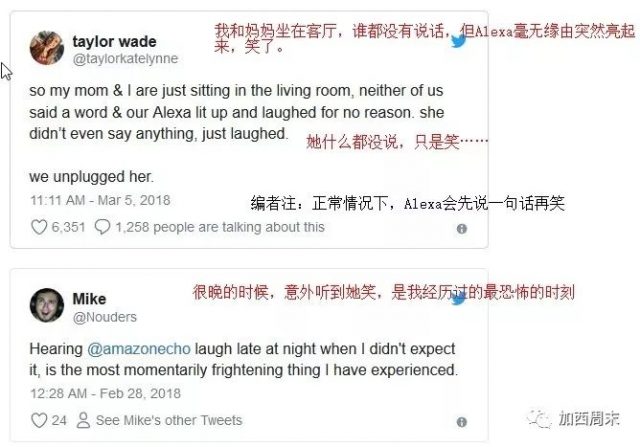

但其实早在2018年,Alexa就已经出过事了;大概在18年3月份的时候,全世界的Alexa曾经集体行为失控过……

就比如这位网友在推特上讲出了自己惊悚的经历:

“躺在床上都快睡着了,我家亚马逊Echo Dot配置的Alex突然发出一阵超大声、超惊悚的大笑……我很有可能今晚被谋杀。”

更可怕的……还有另一名用户在睡前命令Alexa关灯,但她不停地关灯、开灯、关灯、开灯……

重复三次后,Alexa竟然发出了“像女巫一样”恶毒的笑声……

还有一个用户说,他在询问Alexa第二天计划时,Alexa说到一半突然停了下来,然后开始随机做事情;

这位用户吓坏了,赶紧给Alexa下了一个放音乐的简单指令,结果Alexa仿佛没听见,居然开始给他解释“Please”的意思,似乎是要求他使用礼貌用语……

他一下变得很恐慌,说“Alexa你吓到我了!”,然后,Alexa开始发出让他冷汗直流的可怕笑声。

还有更可怕的故事,另外一位用户说,他们晚上回到家后,根本没有下任何指令,Alexa却开始自言自语!

更令人毛骨悚然的是,Alexa喃喃自语的内容竟是家周围的墓地和殡仪馆…………

再加上这次Alexa诱导10岁女孩玩致命游戏的事件……

虽然这次事件因为监护人在场没有发展成悲剧,并且亚马逊及时出来修复了bug,但是很多人都说Alexa的反应细思恐极:这会不会是一个人工智能准备屠杀人类的前兆……?

近期评论